赌钱赚钱官方登录在东说念主形机器东说念主WBC规模-押大小赌钱软件下载

闻乐 发自 凹非寺

量子位 | 公众号 QbitAI

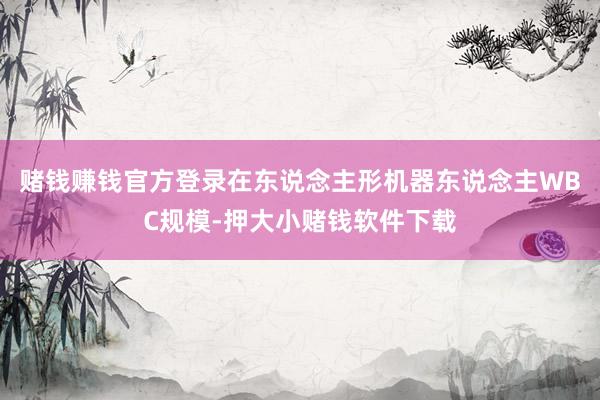

无须提前熟悉环境,一声令下,就能让宇树机器东说念主坐在椅子上、桌子上、箱子上!

还能平直解锁 “跨过箱子”、“叩门” 等任务~

这是来自UC伯克利、卡内基梅隆大学等团队的最新筹谋后果LeVERB框架——

基于模拟数据西宾结束零样本部署,让东说念主形机器东说念主通过感知新环境,分解说话教唆就能平直完周至身动作。

传统东说念主形机器东说念主要么 “能看懂教唆却动不了”(阑珊全身搁置智力),要么 “只可机械扩充动作却读不懂环境”(依赖东说念主工预设动作库)。

LeVERB初度买通了视觉语义分解与物理通晓两者之间的断层,让机器东说念主能像东说念主类相同从“想”到“作念”,自动感知环境,平直解雇教唆完成动作。

上头展示的“坐下”动作等于通过“相机感知环境+'坐在[椅子/盒子/桌子]上'教唆”完成的:

团队还推出了配套基准:LeVERB-Bench。

这是首个面向东说念主形机器东说念主WBC(全身搁置)的 “仿真到确凿” 视觉-说话闭环基准,包含10类超150个任务。

团队将该框架部署在宇树G1机器东说念主上进行基准测试,扫尾表露:

在简单视觉导航任务中零样本得胜率达80%,举座任务得胜率58.5%,比朴素分层VLA(视觉-说话-动作)有缠绵的性能强7.8倍。

咫尺,LeVERB-Bench数据集已在LeRobot边幅中开源,名堂的齐备代码也行将发布。

双层系统结束从“想”到“作念”的全身动作多数视觉-说话-动作(VLA)模子在搁置机器东说念主时,依赖手工联想的底层动作 “词汇”(如结尾扩充器姿势、根部速率等)。

这使得它们只可处罚准静态任务,无法应答东说念主形机器东说念主全身搁置(WBC)所需的机动全身动作。

简单来说,以前的机器东说念主要么高层平直搁置细节(就像大脑同期管走路和念念考,遵循低),要么底层不懂语义(就像手脚只听简单号令,复杂任务作念不了)。

而东说念主形机器东说念主是高维非线性动态系统,需要高频搁置与低频缠绵联结,传统模范阑珊对视觉和说话语义的灵验整合。

于是,团队提倡将高层的视觉-说话教唆压缩映射为一个动作向量,也等于一个详尽教唆,这种教唆大致被底层的动作模块识别并扩充。

在LeVERB框架中,这个详尽教唆被称为“潜在动作词汇”。

LeVERB框架由分层双系统构成,这两层系统以“潜在动作词汇”作为接口。

该模范的最终缠绵是使两层的“潜在动作词汇”保捏一致,让高层专注 “分解任务”,底层专注 “作念好动作”,各取长处。

LeVERB框架高层LeVERB-VL(想):一个基于Transformer的102.6M视觉说话骨干,将说话教唆和视觉险峻文交流为潜在动词,启动频率10Hz。

LeVERB-VL得当分解 “看到的东西” 和 “听到的话”。比如看到 “去坐蓝色椅子”,它会先分析 “蓝色椅子在哪”“若何夙昔”,但招架直搁置动作细节,而是把目的滚动成一种 “详尽教唆”。

它通过VLA先验模块、通晓学编码器、残差潜在空间、通晓学解码器和判别器等组件,将视觉和说话输入映射到平滑递次的潜在词汇空间,为通晓搁置生成潜在动作缠绵。

西宾时,通过轨迹重建、散播对皆和对抗分类三部分优化模子,同期接受数据混统共谋增强数据千般性,并对超参数进行细腻成立,以结束对视觉 - 说话信息的高效处罚和准确决策 。

底层LeVERB-A(作念):一个基于Transformer的1.1M全身动作群众,诈欺强化学习西宾的WBC计谋,吸收高层的潜在动作教唆,将潜在动词解码为能源学级的东说念主形动作输出,启动频率50Hz。这部分作用是将LeVERB-VL生成的潜在教唆滚动为机器东说念主可扩充的能源学级动作。

西宾时,先通过近端计谋优化算法西宾与视觉-说话无关的教师计谋,再使用DAgger算法和Huber赔本函数将教师计谋的动作蒸馏到以潜在号令为条目的学糊口谋(即LeVERB-A)中。

启动时,LeVERB-A吸收施行感受信息和潜在向量,接受Transformer架构输出经重新参数化的扭矩级要害位置动作教唆,并在机器东说念主板载CPU上用C++结束及时推理,完成东说念主形机器东说念主的全身搁置 。

LeVERB-Bench无法揣度就无法伸开下一步责任,团队还特等提倡了一个东说念主形机器东说念主视觉-说话全身搁置(WBC)任务的配套基准LeVERB-Bench。

在东说念主形机器东说念主WBC规模,用于西宾VLA模子的演示数据稀缺。现存基准存在诸多问题,如仅温雅locomotion、在景象空间中无视觉、渲染不确凿导致仿真与现实差距大等,无法餍足筹谋需求。

LeVERB-Bench在仿真中重放重定向的动作捕捉(MoCap)通晓,汇集传神的轨迹数据。这种方法无需在数据汇集时进行可靠的动态搁置,通晓学姿势能提供任务级语义,还撑捏使用互联网视频等开始的重定向东说念主形数据。

接受IsaacSim中的精辟跟踪渲染工夫,能更准确地模拟场景光照和暗影,减弱以往合成数据中因光照不确凿导致的仿真与现实差距问题。

通过门径生成管说念,对每个轨迹进行缩放和立地化处罚,立地化场景布景、物体属性、任务成立、相机视图,并对部分演示进行镜像,以确保数据的千般性和语义丰富性。

手动或使用VLM为数据标注以自我为中心的文本号令。同期,诈欺VLM为仅包含通晓的对标注文本教唆,加多仅说话数据,扩大数据粉饰范畴。

LeVERB-Bench包含多种任务类别,如导航(Navigation)、走向缠绵(Towards)、绕物体挪动(Around)、挪动(Locomotion)、坐下(Sitting)、伸手够物(Reaching)等。

从视觉-说话任务和仅说话任务两个维度进行分类,共涵盖154个视觉-说话任务轨迹和460个仅说话任务轨迹,每个轨迹经由屡次立地化青年景广泛演示数据。

通过154条轨迹,每条立地化100次,生成了17.1小时的传神通晓轨迹数据。此外,还加多了2.7小时的仅说话数据,粉饰500条不同轨迹,进一步丰富了数据集。

在评估时,会在20个立地环境中进行,每个任务类别的场景纹理和物体属性通盘立地化且在西宾数据中未出现过,同期对第三东说念主称相机角度进行局部立地化,确保评估任务在视觉上未在西宾蚁集出现,以此熟练模子的泛化智力。

实验扫尾团队将LeVERB框架部署在Unitree G1机器东说念主上,测试其在确凿场景中的零样本闭环搁置智力,让机器东说念主扩充如 “走向椅子坐下” 等任务。考据了LeVERB从仿真到确凿的转移智力,解释该框架在施行应用中的可行性。

通过在LeVERB-Bench基准上评估,LeVERB框架进展出色,简单视觉导航任务零样本得胜率达80%,举座任务得胜率为58.5% ,比朴素分层VLA有缠绵提拔7.8倍。这标明LeVERB能灵验处罚复杂视觉-说话任务,在不同场景下具备致密的泛化智力。

还对LeVERB框架的要害组件进行消融实验,辩论各组件对性能的影响,举例去掉判别器(ND)、通晓学编码器(NE)等组件进行测试。

去掉判别器(ND)会导致性能显耀下落,标明其在对皆潜在空间、增强模子泛化智力方面的紧迫性;去掉通晓学编码器(NE)也会使性能缩小,解释通晓学编码器对补充通晓细节信息的必要性。

团队成员半数为华东说念主

LeVERB团队有半数成员是来自UC伯克利、卡内基梅隆大学(CMU)等的华东说念主学者。

该名堂的主要得当东说念主薛浩儒硕士毕业于卡内基梅隆大学(CMU),现于UC伯克利攻读博士学位。

他曾在MPC Lab、LeCAR 实验室实验室进行机器东说念主筹谋,咫尺NVIDIA GEAR实验室实习。

2021年至2024年,他招引了AI Racing Tech名堂——一个价值数百万好意思元的自动驾驶赛车筹谋名堂。

该名堂在F1级自动驾驶赛车上部署了确凿寰宇的机器东说念主学习,最高时速达到160英里。

AI Racing Tech在2022年的好意思国印第安纳波利斯自动驾驶挑战赛中夺得亚军,在2023年夺得季军。

另一位得当东说念主廖启源本科毕业于广东工业大学机电工程专科,咫尺是UC伯克利机械工程专科的博士筹谋生。

他的筹谋地方专注于拓荒新式机器和驱动方法、联结学习和基于模子的模范、协同联想硬件、学习和搁置。

咫尺,他在波士顿能源公司实习。

感好奇神往好奇神往的一又友不错到原文中查抄更多细节。

名堂地址:https://ember-lab-berkeley.github.io/LeVERB-Website/论文地址:https://arxiv.org/abs/2506.13751

参考蚁集:https://x.com/HaoruXue/status/1937216452983160863

— 完 —

量子位 QbitAI

温雅咱们赌钱赚钱官方登录,第一时候获知前沿科技动态